TensorRT Inference Optimization: The Complete Guide for Developers and Engineers

- Door

- Uitgever

- Taal

- Engels

- Formaat

- Categorie

Non-fictie

"TensorRT Inference Optimization"

"TensorRT Inference Optimization" is the definitive guide to harnessing the full power of NVIDIA's TensorRT for high-performance deep learning inference. Beginning with a foundational overview of deep learning inference workflows, model format interoperability, and precision modes, the book systematically explores the architectural principles behind TensorRT and practical strategies for optimizing and deploying neural networks across a spectrum of hardware platforms—from data center GPUs to edge devices. Readers gain an in-depth understanding of model conversion processes, handling custom operators, and ensuring reliable and efficient model deployment in real-world production environments.

The book delves into advanced engine optimization techniques including graph-level transformations, memory management, calibration for lower-precision inference, and the integration of custom plugin layers through high-performance CUDA kernels. Comprehensive coverage is also given to deployment architectures, scalable serving solutions such as Triton, multi-GPU/multi-instance scaling, and robust practices for model versioning, security, and continuous integration/deployment. Profiling and benchmarking chapters provide hands-on methodologies for identifying bottlenecks and balancing throughput, latency, and accuracy, ensuring peak system performance.

Catering to both practitioners and researchers, the guide navigates state-of-the-art topics such as asynchronous multi-stream inference, distributed and federated deployment scenarios, post-training quantization, sequence model optimization, and automation within MLOps pipelines. Concluding with future trends, open challenges, and the expanding TensorRT community ecosystem, this volume is an essential resource for professionals seeking to maximize deep learning inference efficiency and drive innovation in AI-powered applications.

© 2025 HiTeX Press (E-boek): 6610001024444

Verschijnt op

E-boek: 20 augustus 2025

Anderen genoten ook van...

- Wat moed dat moet: mijn leven in flarden Simon Keizer

- Al het blauw van de hemel Mélissa Da Costa

- Onvergetelijk: Een jaar later - Over Eva, gemis en het fijne van herinneringen Hanneke Mijnster, Matthijs Hermans

- Mijn naam is Edino Edino van Dorsten

- Moederland Noortje Brink

- De kerstmissie (1) Lisanne Stam

- De hulp: Vanachter gesloten deuren ziet zij alles... Freida McFadden

- Het laatste lied Lucinda Riley

- De crash Freida McFadden

- Post mortem: Cases en verhalen uit de praktijk van de bekendste patholoog van Nederland Frank van de Goot

- Zeven brieven Tina de Bruin

- Harry Potter and the Philosopher's Stone J.K. Rowling

- Adem Saskia Noort

- Niets is wat het lijkt: Depressie in de spotlight Fred van Leer, Conny Schalke

- Liften naar de hemel Lex Paleaux

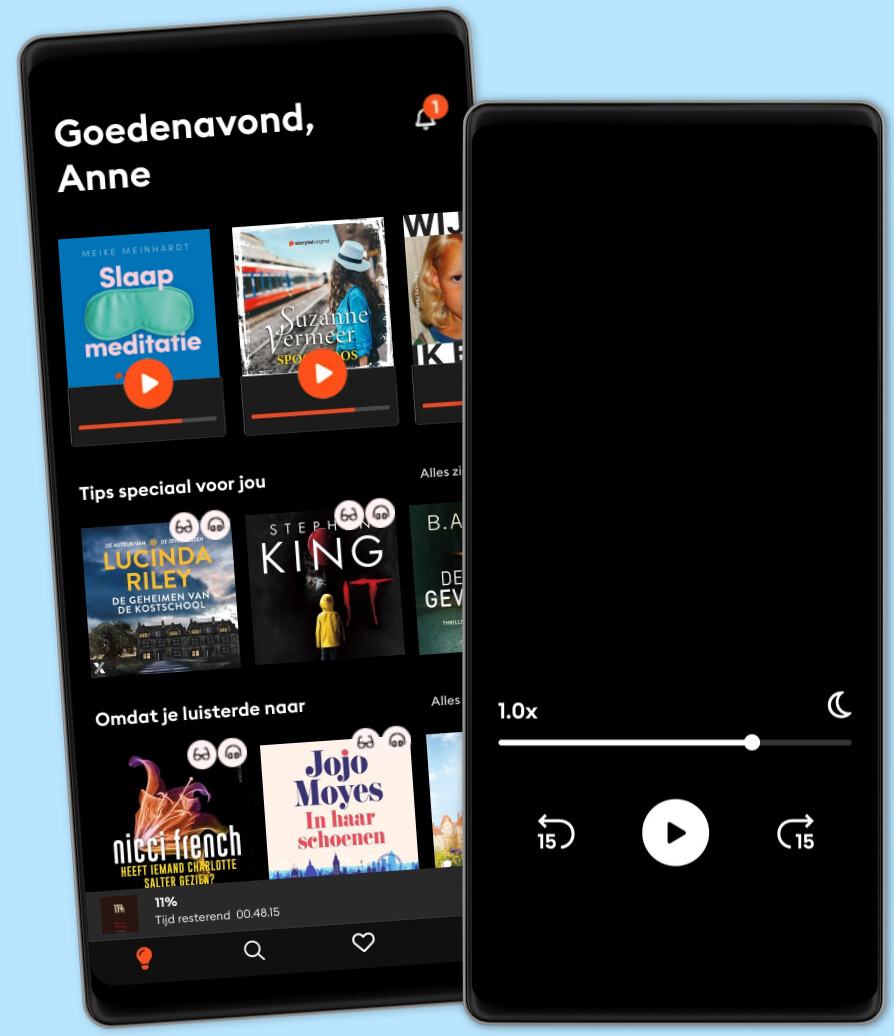

Maak je keuze:

Kies het aantal uur en accounts dat bij jou past

Kids Mode - een veilige omgeving voor kinderen

Download verhalen voor offline toegang

Al 2,5 miljoen abonnees wereldwijd

★★★★★ 4,7 in de App Store

Unlimited

Voor wie onbeperkt wil luisteren en lezen.

€13.99 /30 dagen

Meer dan 1 miljoen luisterboeken en ebooks

Altijd opzegbaar

Premium

Voor wie zo nu en dan wil luisteren en lezen.

€9.99 /30 dagen

Meer dan 1 miljoen luisterboeken en ebooks

Altijd opzegbaar

Flex

Voor wie Storytel wil proberen.

€7.99 /30 dagen

Spaar ongebruikte uren op tot 50 uur

Meer dan 1 miljoen luisterboeken en ebooks

Altijd opzegbaar

Family

Voor wie verhalen met familie en vrienden wil delen.

Vanaf €18.99 /30 dagen

Meer dan 1 miljoen luisterboeken en ebooks

Altijd opzegbaar

€18.99 /30 dagen