Enhancing Deep Learning Performance Using Displaced Rectifier Linear Unit

- מאת

- הוצאה לאור

- שפה

- אנגלית

- פורמט

- קטגוריה

עיון

Recently, deep learning has caused a significant impact on computer vision, speech recognition, and natural language understanding. In spite of the remarkable advances, deep learning recent performance gains have been modest and usually rely on increasing the depth of the models, which often requires more computational resources such as processing time and memory usage. To tackle this problem, we turned our attention to the interworking between the activation functions and the batch normalization, which is virtually mandatory currently. In this work, we propose the activation function Displaced Rectifier Linear Unit (DReLU) by conjecturing that extending the identity function of ReLU to the third quadrant enhances compatibility with batch normalization. Moreover, we used statistical tests to compare the impact of using distinct activation functions (ReLU, LReLU, PReLU, ELU, and DReLU) on the learning speed and test accuracy performance of VGG and Residual Networks state-of-the-art models. These convolutional neural networks were trained on CIFAR-10 and CIFAR-100, the most commonly used deep learning computer vision datasets. The results showed DReLU speeded up learning in all models and datasets. Besides, statistical significant performance assessments (p<0.05) showed DReLU enhanced the test accuracy obtained by ReLU in all scenarios. Furthermore, DReLU showed better test accuracy than any other tested activation function in all experiments with one exception.

© 2022 Editora Dialética (ספר דיגיטלי): 9786525230757

תאריך פרסום

ספר דיגיטלי: 25 במרץ 2022

אחרים גם נהנו...

- מחר יהיה אחרת יובל אברמוביץ

- ארבע ההסכמות דון מיגל רואיס

- כראמל (10) הסוף? מאירה ברנע גולדברג

- האיש שאהב את הטלפון שלו יותר מדי יובל אברמוביץ', יובל אברמוביץ

- בעלי לא בבית מירב הלפרין

- סדר את המיטה שלך אדמירל ויליאם ה. מקרייבן

- Heated Rivalry Rachel Reid

- הרגלים אטומיים ג'יימס קליר

- סבתא בורחת מהבית מאירה ברנע גולדברג

- שנת המתנות יובל אברמוביץ'

- Fourth Wing (1 of 2) [Dramatized Adaptation]: The Empyrean 1 Rebecca Yarros

- Harry Potter and the Philosopher's Stone J.K. Rowling

- Game Changer Rachel Reid

- The Long Game Rachel Reid

- Iron Flame (1 of 2) [Dramatized Adaptation]: The Empyrean 2 Rebecca Yarros

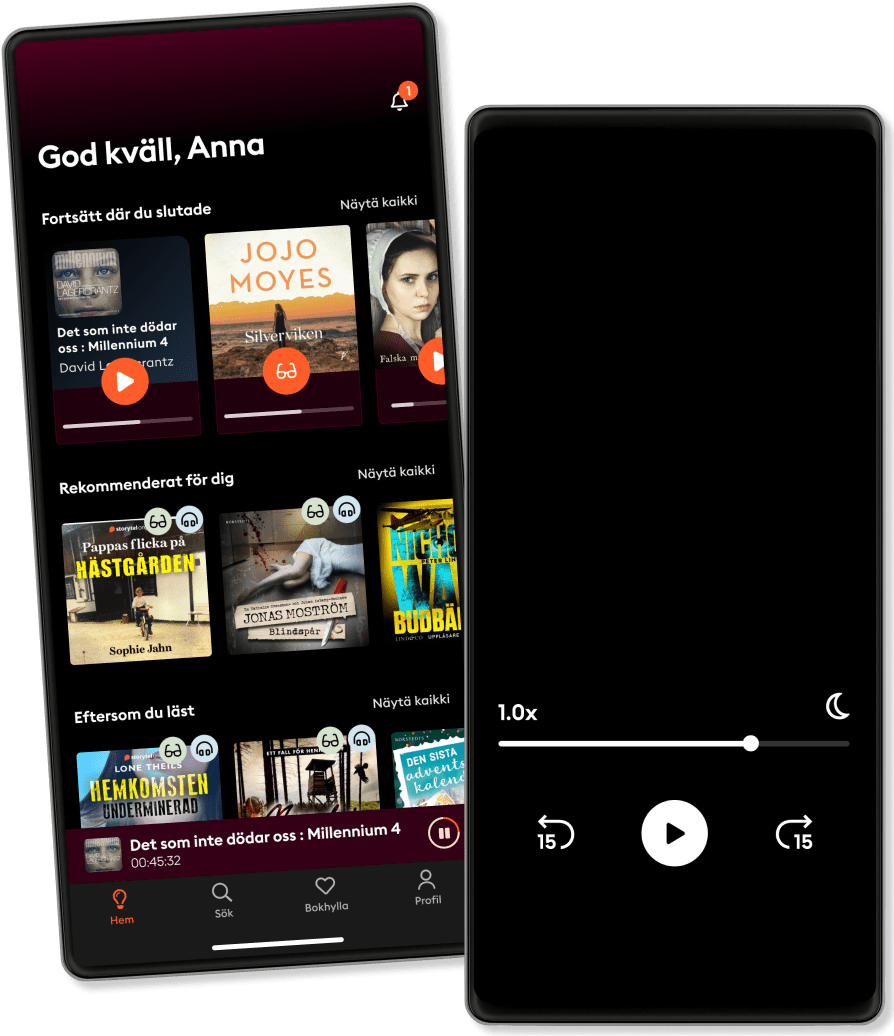

איזה מינוי מתאים לך?

מאות אלפי ספרים

מצב ילדים (תוכן שמתאים לקטנטנים)

הורדת ספרים לקריאה והאזנה בלי אינטרנט

אפשר לבטל בכל עת